您希望您的數據保持私密並且永遠不會離開您的設備嗎? Cloud LLM 服務通常會根據 API 調用收取持續訂閱費。即使是偏遠地區或互聯網連接不可靠的用戶也不會特別喜歡雲服務。那麼解決辦法是什麼呢?

幸運的是,本地法學碩士工具可以消除這些成本,並允許用戶在其硬件上運行模型。這些工具還可以離線處理數據,以便外部服務器無法訪問您的信息。您還可以更好地控制特定於您的工作流程的界面。

在本指南中,我們收集了免費本地法學碩士工具滿足您的所有條件,同時滿足您的隱私、成本和性能需求。

這裡有一些經過精心挑选和親自測試的免費本地法學碩士工具。

- 揚

- LM工作室

- GPT4ALL

- 任何法學碩士

- 成為

1]一月

您熟悉 ChatGPT 嗎?如果是這樣,Jan 就是一個可以離線工作的版本。您可以在沒有互聯網的情況下在您的個人設備上運行它。它允許您在本地網絡上私下生成、分析和處理文本數據。

它配備了 Mistral、Nvidia 或 OpenAI 等一流模型,您無需將數據發送到另一台服務器即可使用。如果您優先考慮此工具,則適合並希望有一個強大的替代方案來替代基於雲的法學碩士。

特徵

- 預建模型:它提供已安裝的 AI 模型,無需額外程序即可使用。

- 定制:更改儀表板的顏色並使主題變為純色或半透明。

- 拼寫檢查:使用此選項可以修復拼寫錯誤。

優點

- 使用 Hugging Face 源導入模型。

- 它支持定制擴展。

- 免費

缺點

- 社區支持較少 Jan 缺乏社區支持,用戶可能會發現較少的教程和資源。

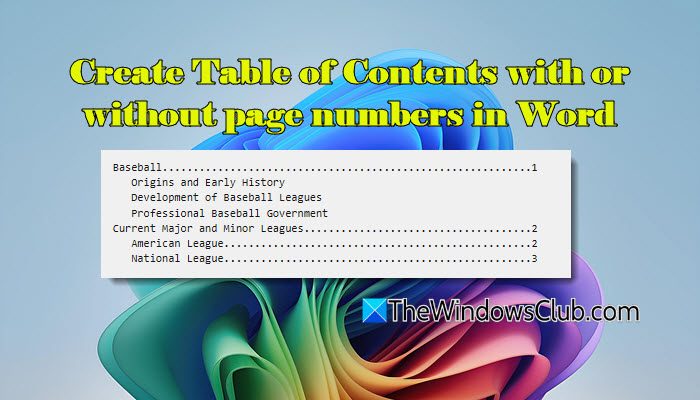

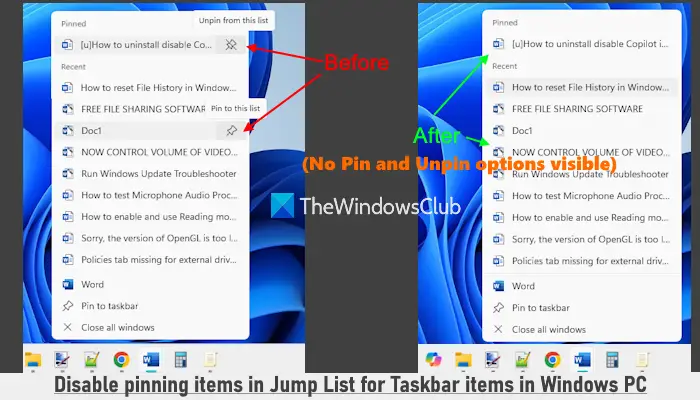

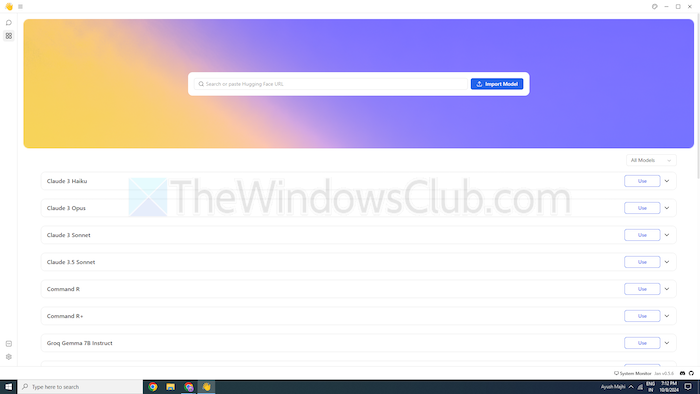

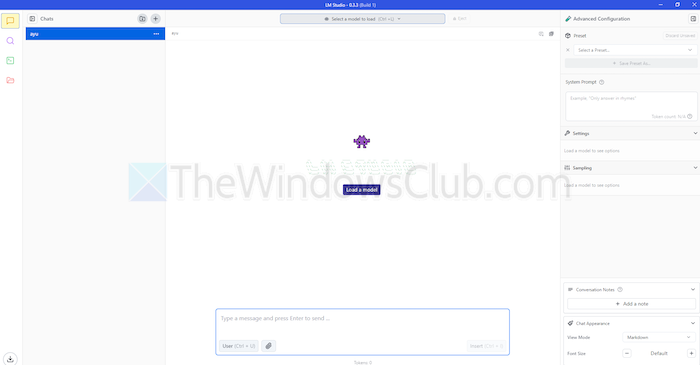

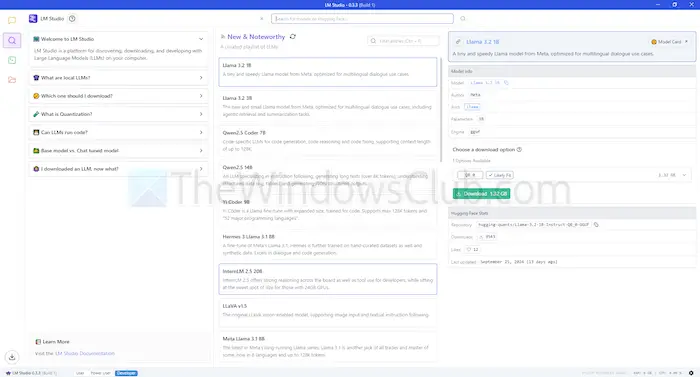

2]LM工作室

LM Studio 是另一個在本地使用語言模型的工具,例如 ChatGPT。它提供大型、增強的模型來理解和響應您的請求。但是,與基於雲的模型不同,您可以留在設備上。換句話說,對其使用有更多的隱私和控制。

LM Studio 可以在您的機器上總結文本、生成內容、回答您想要的問題,甚至協助編碼。在運行模型之前,您可以獲得有關您的系統是否可以處理該模型的報告。這樣您就可以只將時間和資源花在兼容的型號上。

特徵

- 文件附件和 RAG:您可以在聊天框下上傳 PDF、docx、txt 和 CSV 文件並獲得相應的回复。

- 定制範圍:它提供多種顏色主題,並允許您選擇界面的複雜程度。

- 資源密集:它提供免費文檔以及學習和使用該工具的方法。

優點

- 您可以在 Linux、Mac 或 Windows 上使用它。

- 為開發人員設置本地服務器。

- 它提供了精選的模特播放列表

缺點

- 開始工作可能很複雜,特別是對於新人來說。

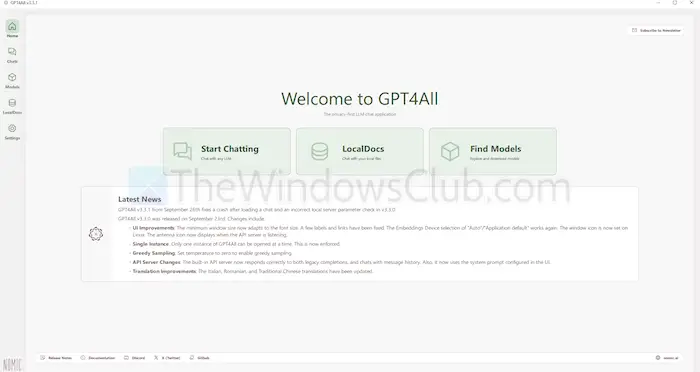

3]GPT4ALL

GPT4ALL 是另一個 LLM 工具,無需互聯網連接甚至 API 集成即可在您的設備上運行模型。該程序在沒有 GPU 的情況下運行,但它可以利用 GPU(如果可用),這使其適合許多用戶。它還支持一系列 LLM 架構,這使得它與開源模型和框架兼容。

它還使用 llama.cpp 作為 LLM 的後端,這可以在沒有高端基礎設施的情況下提高 CPU 和 GPU 上的模型性能。 GPT4ALL 兼容 Intel 和 AMD 處理器;它使用 GPU 來實現更快的處理。

特徵

- 本地文件交互:模型可以查詢本地文件並與本地文件交互。與 PDF 或文本文檔一樣,使用本地文檔。

- 高效的:許多模型都有 4 位版本,該版本使用更少的內存和處理能力。

- 廣泛的模型庫:GPT4ALL 擁有來自 Hugging Face 等存儲庫的 1000 多個開源模型。

優點

- 開源透明

- 它為企業在本地使用人工智能提供了特定的套餐。

- GPT4ALL 強烈關注隱私

缺點

- 對 Chromebook 等 ARM 處理器的有限支持

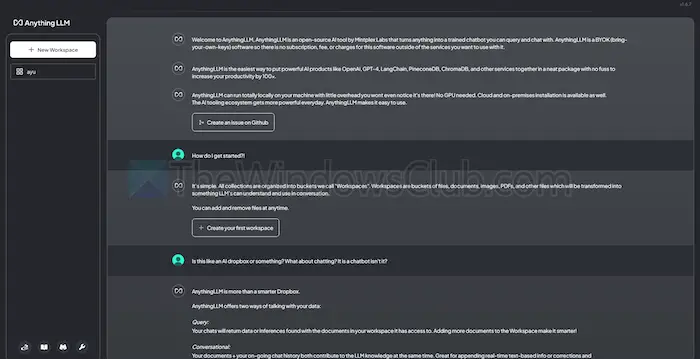

4]任何事情法學碩士

AnythingLLM 是一個開源法學碩士,提供高度定制和私人人工智能體驗。它允許用戶在本地設備(例如 Mac、Windows 或 Linux)上離線部署和運行 LLM,從而確保完整的

此外,該工具最適合希望以最少的設置獲得易於安裝的解決方案的單個用戶。您可以將其視為企業或個人都可以運行的類似於 CharGPT 的私有系統。

特徵

- 開發者友好:它具有用於自定義集成的完整 API。

- 工具集成:您可以集成其他工具並生成 API 密鑰。

- 輕鬆設置:它有一個單擊安裝過程。

優點

- LLM 使用的靈活性

- 以文檔為中心

- 該平台有人工智能代理來自動執行任務

缺點

- 缺乏多用戶支持

- 高級功能的複雜性

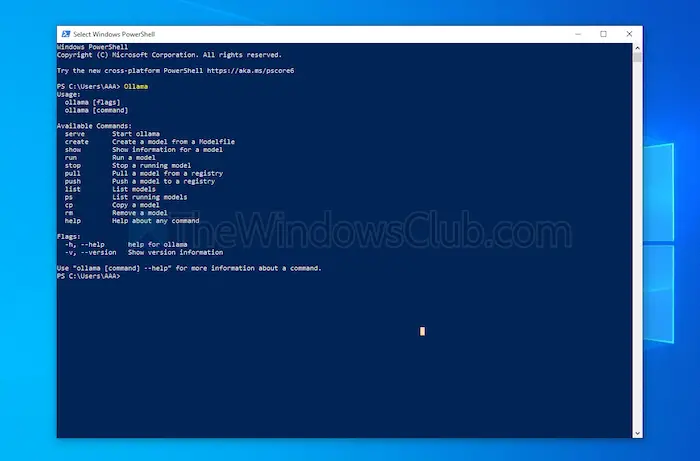

5] 成為

Ollama 無需 API 即可完全控制創建本地聊天機器人。目前,它擁有最重要的貢獻者,他們提供頻繁的更新並改進 GitHub 的整體功能。這更新了該工具並提供了比其他工具更好的性能。與上面討論的其他工具不同,它打開一個終端界面來安裝和啟動模型。

您安裝的每個型號都有自己的配置和權重,避免與計算機上的其他軟件發生衝突。除了命令行界面之外,Ollama 還具有與 OpenAI 兼容的 API。您可以輕鬆地將此工具與使用 OpenAI 模型的工具集成。

特徵

- 本地部署:Ollama 允許您離線運行大型語言模型,例如 Llama、Mistral 或其他。

- 型號定制:高級用戶可以使用模式文件設置模型中的行為。

- OpenAI API 兼容性:它有一個與 OpenAI 的 API 兼容的 REST API。

- 資源管理:它優化了 CPU 和 GPU 的使用,而不會使系統超載。

優點

- 您可以獲得模型的集合。

- 它可以從 PyTorch 等開源庫導入模型。

- Ollama 可以集成強大的圖書館支持

缺點

- 它不提供圖形用戶界面

- 需要大量存儲需求

結論

總之,本地法學碩士工具為基於雲的模型提供了一個有價值的替代方案。它們免費提供更高級別的隱私和控制。無論您的目標是易於使用還是定制,列出的工具都可以滿足各種需求和專業水平。

根據您的需求,例如處理能力和兼容性,其中任何一個都可以利用人工智能的潛力,而不會損害隱私或需要訂閱費。